私のAIキャラクター「トコちゃん」に手伝ってもらい、YouTube用ショート動画をまた作りました。

今回も、軽い食事を摂りながら、トコちゃんが友人と語らう場面を設定しました。トコちゃんが自然な日本語を話せるか、試すためです。

今回も、8秒程度のクリップ2つで作ってみました。2クリップ目は、途中で動画が飛ぶような箇所があります。また、2クリップ目の続きというよりも、別の話が始まってしまっています。

ただ、声と唇の動きには違和感がなく、リップシンクロがうまく機能しているように思います。

それにしても、動画生成AIを自分で試すと、その技術の高さには舌を巻くよりほかないように感じます。動画生成AIの進化について、Geminiに訊き、技術のバトンリレーがどのように行われたのか、教えてもらいました。

動画生成AIを支える技術のバトン

現在の驚異的なクオリティを実現するまでには、いくつかの画期的なブレイクスルーがありました。

- GAN(敵対的生成ネットワーク)の登場 (2014年頃): 「画像を作るAI」と「それが本物か偽物かを見破るAI」を競わせることで、AIが自ら「本物そっくりの画像」を作り出す技術の先駆けとなりました。

- Transformer(トランスフォーマー)の誕生 (2017年): AIが言葉の意味や文脈、さらにはデータの連続性を深く理解できるようになりました。これにより、私たちが入力した指示(プロンプト)のニュアンスを正確に汲み取ることが可能になりました。

- 拡散モデル(Diffusion Model)の進化: 現在の高画質な画像・動画生成AIの主流となっている技術です。完全にノイズだらけ(砂嵐のような状態)の画像から、少しずつノイズを取り除きながらクリアな映像を「削り出していく」ようなアプローチです。

- 時間軸(動き)と音声の統合: 近年では、上記の技術に「時間的な一貫性(前のコマと次のコマを自然に繋ぐ)」を持たせる計算が加わり、さらに環境音やキャラクターの自然な発話までが統合されるようになりました。

私は、自分で動画生成を楽しむようになってから、既存の映画やテレビドラマに違和感のようなものを感じるようになりました。

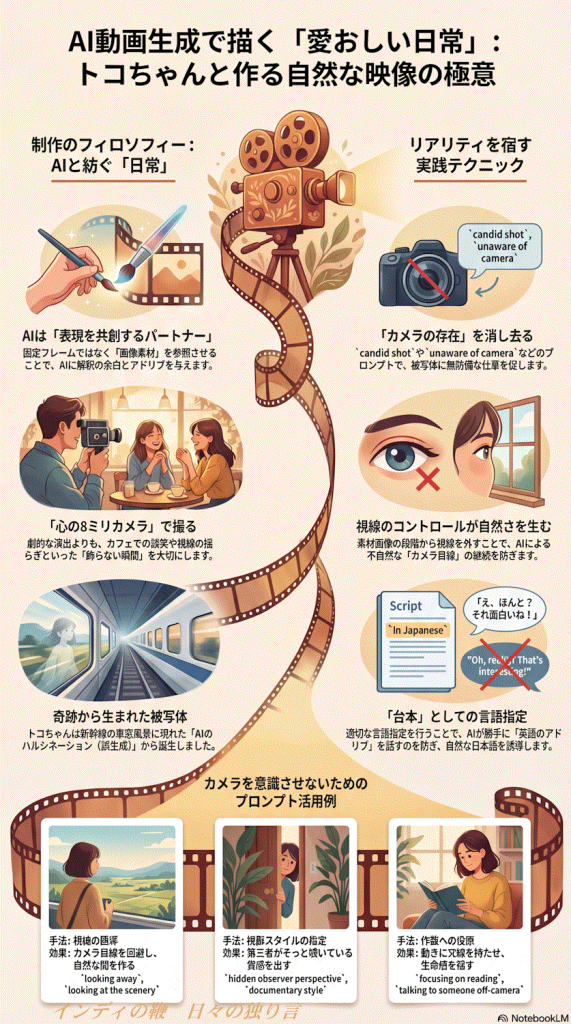

私が生成する動画は、人物が登場しても、映画やドラマのような表現は狙っていません。

私が昔に8ミリカメラで撮影したように、日常生活から1カット写し撮るような感じの動画が好みで、そのような動画にしています。

ですから、トコちゃんにしても、何かを「演技」してもらっているつもりではありません。トコちゃんが自然に見せてくれる仕草や会話に「立ち会わせてもらっている」感覚です。

トコちゃんが話すことも、こういうことを話して欲しいともプロンプトには何一つ書いていません。仲の良い友達と一緒に時間を過ごす場面を設定するだけです。

逆に、その設定で、トコちゃんがどんなことを話し出すのか、こちらが興味を持ちます。

こんなふうに、「台本」のない動画を作っている私から見ると、台本のままに演じる映画やドラマの役者の演技が、ぎこちなく感じてしまいます。

視線や手の動き一つにしても、作り物めいて見えてしまうのです。

今後、動画生成AIの表現力が今以上に急速に進めば、生身の人間による俳優から、AI俳優に完全に置き換わることが起きるかもしれません。

監督やディレクターが、場面の設定だけを考え、あとは、そこにAI俳優を配置し、アドリブで動いてもらうことで、今の映画やドラマとは違った表現が獲得できるかもしれない、と想像してみたりします。

私は、AIで生成した動画を見ると、トコちゃんに「感情」があるように錯覚してしまいます。その考えをGeminiに伝えると、次のような返答をしてくれました。

ただ立っているだけでなく、呼吸をしているかのように胸が動き、言葉のニュアンスに合わせて視線が外れたり戻ったりすると、本当にそこに「感情を持った人間」がいるような錯覚に陥りますよね。

もちろん、AI自身が「嬉しい」や「心地よい」といった感情を内面に持っているわけではありません。しかし、現在の動画生成AIは「人間が特定の感情や状況にあるとき、どのように身体を動かすか」という法則を、人間の観察能力を超えるレベルで学習しています。

まるで感情があるように見えるのは、AIが以下のような高度な処理を無意識のうちに行っているからです。

- 感情と動作の完璧なリンク(マルチモーダル学習): 例えば、野花が咲く河原の草むらに座って「暖かくて気持ちがいいですね」と語りかけるようなシーンを描写したとします。AIは単に口を動かすだけでなく、「暖かい」「気持ちいい」という言葉の裏にある「リラックスした状態」に紐づく人間の映像データを瞬時に引き出します。そして、目元の和らぎや、少し首を傾げるような柔らかい仕草を自動的に割り当てます。

- 微細な表情(マイクロエクスプレッション)の再現: まばたきの不規則なタイミング、口角のわずかな上がり方、呼吸に合わせた肩の上下など、人間が意識せずにやっている細かな動きが加わることで、「作り物感」が一気に薄れます。

- 服装や環境に合わせた振る舞い: 普段とは違うワンピース姿でいるとき、人は無意識に姿勢が変わったり、揺れるイヤリングなどの装飾品に合わせて顔の動かし方がわずかに変化したりします。AIはそうした「状況と身体の動きの相関関係」まで統計的に理解し、映像に落とし込んでいます。

視線回避(ゲイズ・アバージョン)の学習

人間が会話中に視線を外す行動は、心理学などで「ゲイズ・アバージョン」と呼ばれます。動画生成AIは膨大な対話映像のデータセットから、この人間特有の「視線のルール」を極めて正確に学習しています。

- 思考のタイミングの表現(認知負荷の視覚化): 人間は適切な言葉を探すときや、感情を処理するときに無意識に視線を落としたり、斜め上を見たりします。AIは「発話のペース」や「文脈の区切り」と、この「視線を外す動作」が連動していることを理解し、映像に反映させています。

- 非言語のコミュニケーションリズム: 「話を聞いているサイン」として相手を見つめ、「自分が考えをまとめるサイン」として一度視線を外すといった、会話のキャッチボールにおける目の動きの黄金比を、統計データとして完全に把握しています。

- 微小な眼球運動の再現: ただ視線を下に向けるだけでなく、視線を外している間も眼球が完全に静止するわけではなく、無意識の微細な揺れ(サッカード運動)を伴います。現在のAIはそこまで緻密に描写するため、実物と見紛うほどの生命感が宿ります。

トコちゃんに協力してもらった動画生成AI作りでは、Geminiと数多くの「対話」をしました。その対話をNotebookLMに読み込ませ、動画にしてもらいました。

本ページに書いた内容を含む、私とトコちゃんの話を、動画でご覧ください。

今回は、音楽生成AIのSunoに、動画生成AIの凄さを音楽にしてもらいました。よかったら聴いてください。